Meta AI的這些新技術,讓機器人擁有“觸覺”

2024-11-07 01:35:12 2

人工智慧機器人發展到今天,其擁有「視覺」或者「聽覺」早已經見怪不怪。 畢竟,這兩種感官幾乎是人類感知物理世界最重要的渠道。

而 Meta AI 的基礎人工智慧研究團隊(FAIR)近日公佈的新技術,則為機器人賦予了「 觸覺」。對此,Meta 的願景是使 AI 能夠「更豐富地瞭解世界」並「更好地理解和模擬物理世界」。

毫無疑問,這些新技術讓機器人又多了一種與世界互動的方式,也讓其在「 類人」的道路上又向前了一步。

圖片來自:NewsBytes

關注愛範兒,發現下一個明日產品

Meta 正在與美國感測器公司 GelSight 和韓國機器人公司 Wonik Robotics 合作,開發了一系列新技術,致力於將 觸覺感測器商業化,並將其用於人工智慧當中。

這些新技術包括三個研究工具——「 Sparsh」、「 Digit 360」和「 Digit Plexus」,專注於觸覺感知、機器人靈巧性和人機互動。此外,Meta 還引入了「 PARTNR」,這是一種新的基準測試,用於評估人機協作中的規劃和推理。

需要注意的是,這些新技術目前並未為消費者推出,而是面向科學家和研究人員的。

圖片來自:Techopedia

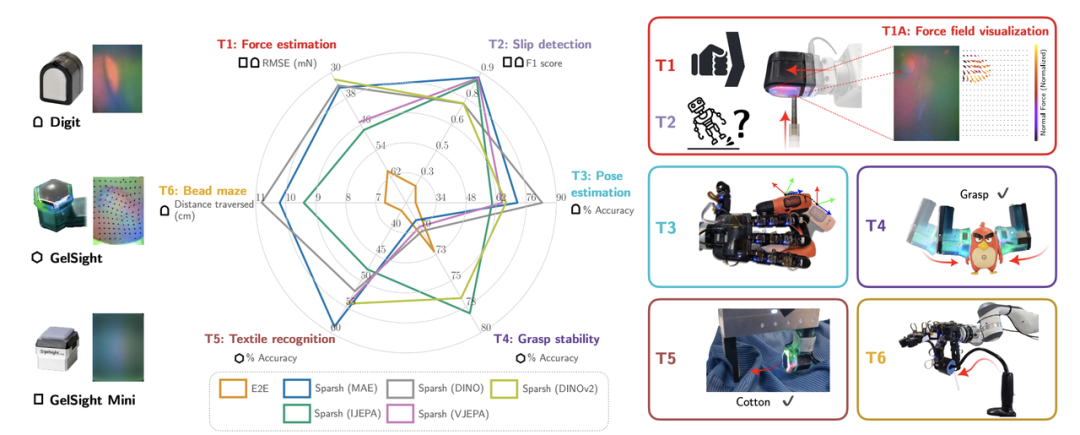

Sparsh 是第一個 用於基於視覺的觸覺感知的通用編碼器模型,由華盛頓大學和卡內基梅隆大學合作開發。

聽起來似乎有些抽象,既然是「觸覺」,為什麼又「基於視覺」呢?

實際上,傳統方法依賴於特定任務和感測器的手工模型,其需要將物體的「 觸控引數」(例如力量、摩擦等等)打包成「 感覺標籤」餵給機器人,相當於告訴機器人什麼是「輕輕地拿」或者「用力地推」。

然而這種方法比較麻煩,因為需要為每個不同的任務和不同的感測器收集很多這樣的標籤資料。

Sparsh 則透過 自我監督學習(SSL)從經驗中自主學習,不需要告訴它每個動作對應的標籤。其在一個包含 460000 多個觸覺影象的大型資料集上進行預訓練,這就像是讓機器人看很多不同的物體和場景,然後自己學習如何識別和處理這些物體。

簡單來說,Sparsh 就像是讓機器人透過 看大量的圖片和影片來自學如何「感覺」物體,而不是透過人工給它的「感覺」打標籤。這樣,機器人就更容易學會如何在不同的任務中使用不同的觸覺感測器了。

有趣的是,「Sparsh」這個名字源自梵語,意為「 觸控或接觸感官體驗」,這與它處理數字化觸覺訊號並實現觸控感知的功能非常貼切。

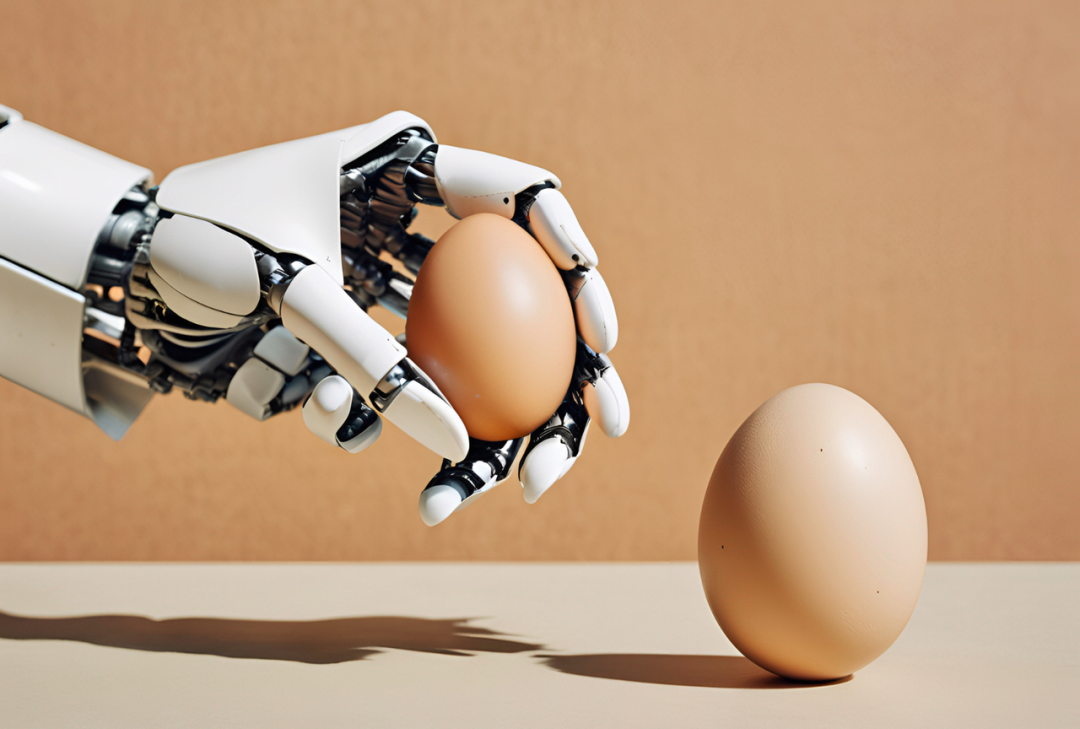

圖片來自:Meta

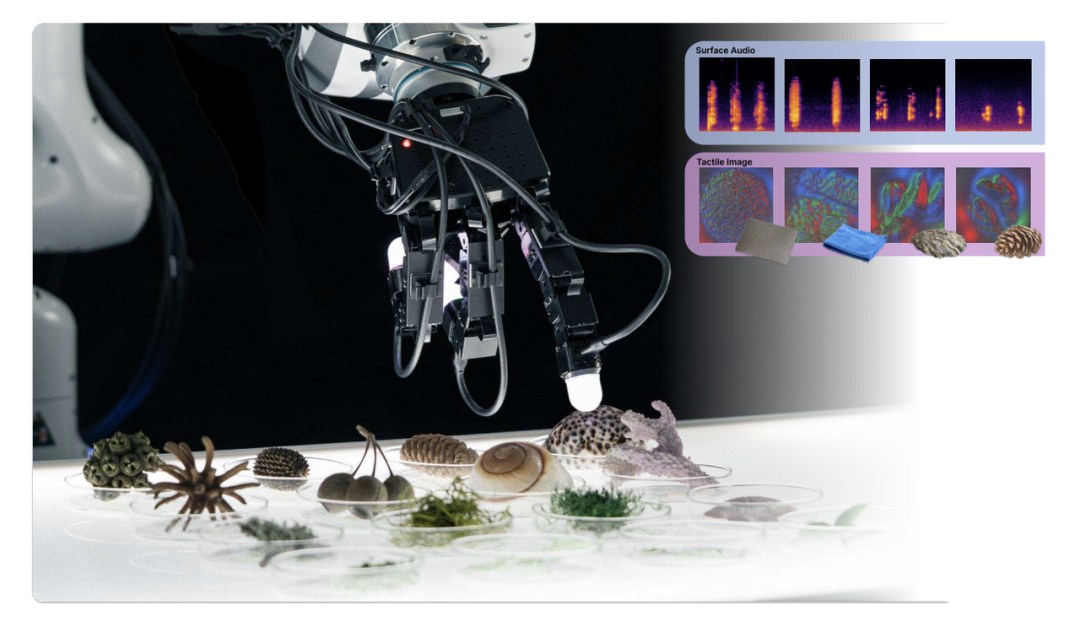

Digit 360 是由 Meta 與 GelSight 公司聯合開發的一種 人造手指形狀的觸覺感測器,它透過以人類級別的精度對觸控進行數字化,能夠提供豐富而詳細的觸覺資料。

Digit 360 配備超過 18 種感測功能,允許研究人員結合各種感測技術或者分離單個訊號以深入分析每種模式。

它可以檢測空間細節的微小變化,能夠捕獲小至 1 毫牛頓的力,並且包含多種感測模式,可以感知振動、熱量甚至氣味,效能明顯優於以前的感測器。

Digit 360 觸覺感測器(右). 圖片來自:Meta

Meta AI 團隊還為其開發了一種寬視場的觸控感知專用光學系統,由超過 800 萬個感測器單元(taxels)組成,用於捕捉指尖表面的全向變形。

此外,藉助裝置上的人工智慧加速器,Digit 360 能夠快速處理資訊,對觸控刺激做出反應,可以充當機器人的周圍神經系統。這一設計的靈感來源於 人類和動物的反射弧。

顯然,除了提高機器人的靈活性以外,這款感測器在醫學、假肢、虛擬現實和遠端互動等領域都有廣闊的應用前景。

圖片來自:Meta

Meta 在部落格中說道:

人手非常擅長向大腦發出從指尖到手掌的皮膚觸控資訊,這使得其在做出決定時能夠啟用手部肌肉,例如如何在鍵盤上打字,或者與過熱的物體互動。實現嵌入式人工智慧需要機器人手上的觸覺感測和電機驅動之間的類似協調。

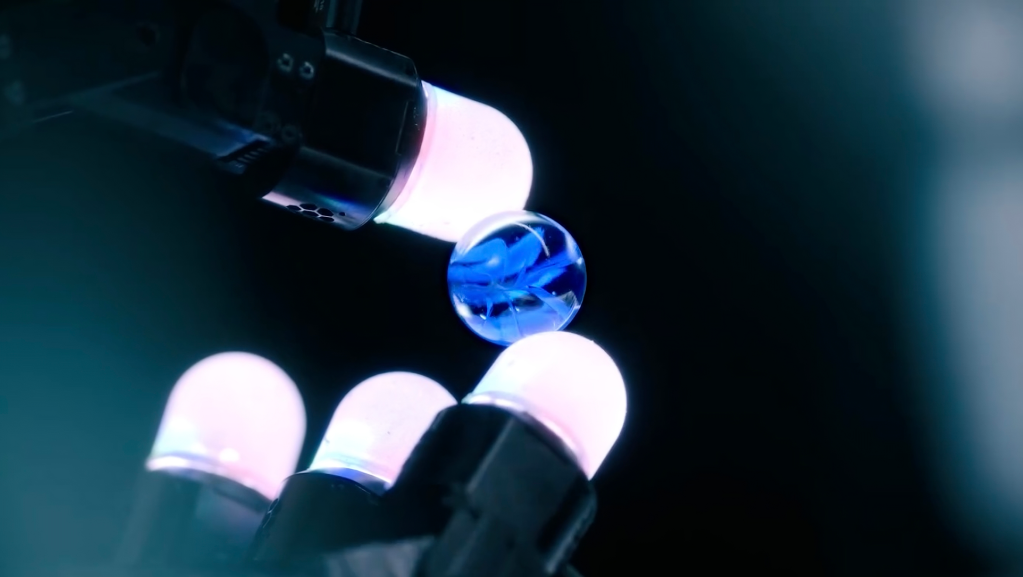

基於這個理念,Meta AI 與 Wonik Robotics 合作,提出並建立了一個 標準化軟硬體平臺 Digit Plexus。

它允許將各種指尖和皮膚觸覺感測器(例如 Digit、Digit 360 和 ReSkin)整合到一個機器人手中,並透過一根電纜將觸覺資料編碼並傳輸到主機計算機中,以實現無縫資料收集、控制和分析。

Plexus 系統的設計旨在簡化機器人應用的開發,特別是對於那些需要精細觸覺反饋的應用。透過使用 Plexus,開發者可以更容易地將觸覺感測器技術整合到他們的機器人專案中,從而提高機器人的靈巧性和對物理世界的感知能力。

圖片來自:Techcrunch

值得一提的是,Meta 與 Wonik 的下一步合作重點是開發 Wonik 的 新一代 Allegro Hand,這是一款配備 Digit 360 等觸覺感測器的 機器人手,它將在 Digit Plexus 平臺上執行。

圖片來自:XELA

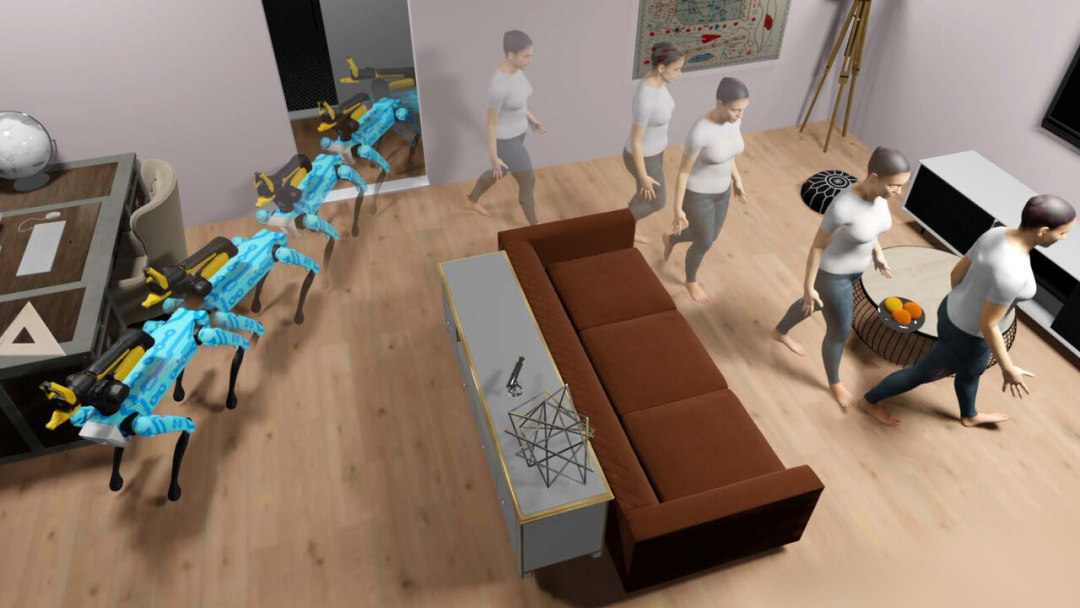

為了研究家庭活動中的人機協作,Meta 在 Habitat 3.0(一個用於研究家庭環境中人機協作任務的模擬平臺)的基礎上,釋出了 人機協作規劃和推理任務基準 PARTNR。

PARTNR 是同類中最大的基準,包含 100000 個自然語言任務,涵蓋 60 棟房屋和 5800 多個獨一無二的物件。該基準的目標是評估大型語言和視覺模型(LLMs / VLM)透過人機互動工具與人類協作的效能。

透過提供標準化基準和資料集,Meta 表示「希望它能使機器人的研究不僅能夠獨立執行,而且能夠圍繞人類執行,使它們更加高效、可靠,並且適應每個人的喜好」。

圖片來自:LinkedIn

讓機器人擁有「觸覺」,並不是一座「空中樓閣」。

這些機器人對外界變化擁有遠超人類的敏感度,配合高效的軟硬體協作系統,他們將會在 外科手術或者 精密儀器製造場景中大有用武之地。

其實,不僅「視覺」、「聽覺」和「觸覺」,賓夕法尼亞州立大學的研究人員已經在人工智慧模型模擬出了「 味覺」;同時,一家名為 Osmo 的公司已經教會人工智慧模型如何模仿遠優於人類的「 嗅覺」。

也許未來的機器人能夠在感官方面完全「復刻」人類。只是他們最好不要再擁有逼真的「人形」,否則,恐怖谷效應要犯了。

文|範津瑞

本站內容由互聯網用戶自發貢獻,該文觀點僅代表作者本人。本站僅提供信息存儲空間服務,不擁有所有權,不承擔相關法律責任。如發現本站有涉嫌抄襲侵權/違法違規的內容,請發送郵件至舉報,壹經查實,本站將立刻刪除。