填補AI安全空白:谷歌上線安全人工智慧框架風險評估工具

2024-10-27 01:32:34 2

IT之家 10 月 26 日訊息,谷歌公司於 10 月 24 日釋出博文,宣佈推出 SAIF 風險評估工具,旨在幫助人工智慧開發者和組織評估其安全態勢,識別潛在風險,並實施更強的安全措施。

SAIF 簡介

IT之家注:谷歌去年釋出了安全人工智慧框架(SAIF),旨在幫助使用者安全、負責任地部署 AI 模型,SAIF 不僅分享了最佳實踐,還為行業提供了一個安全設計的框架。

為了推廣這一框架,谷歌與行業夥伴共同成立了安全人工智慧聯盟(CoSAI),以推動關鍵的 AI 安全措施。

SAIF 風險評估工具

谷歌目前已經在新網站 SAIF.Google 上提供 SAIF 風險評估工具,該工具以問卷形式執行,使用者回答後會生成定製化的檢查清單,指導他們確保 AI 系統的安全。

工具涵蓋多個主題,包括:

AI 系統的訓練、調優和評估

對模型和資料集的訪問控制

防止攻擊和對抗性輸入

生成性 AI 的安全設計與編碼框架

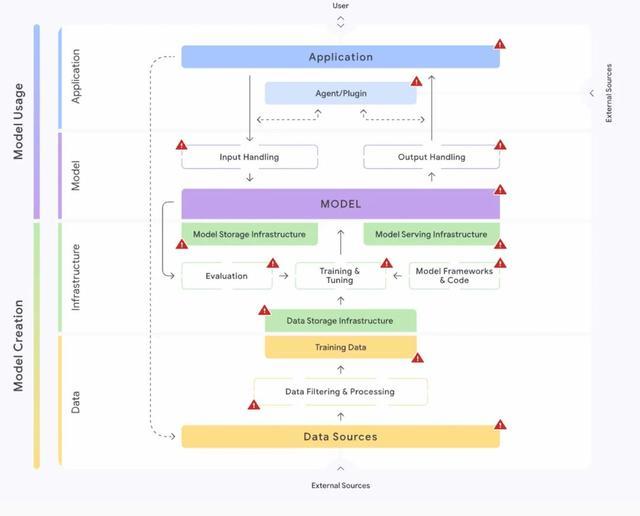

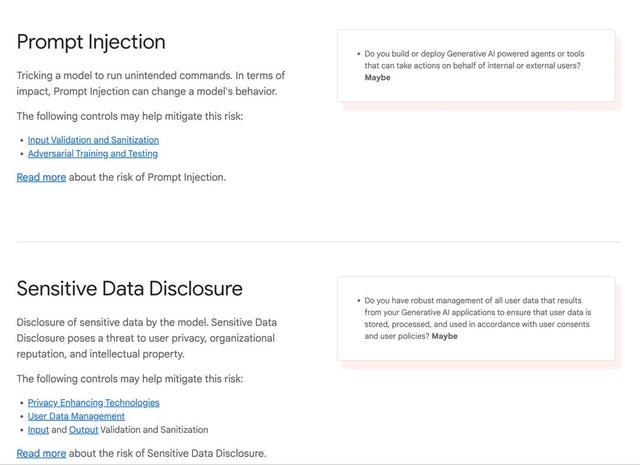

使用者在回答問題後,工具會立即生成一份報告,突出 AI 系統面臨的具體風險,如資料中毒、提示注入和模型源篡改等。

每個風險都附有詳細解釋及建議的緩解措施,此外使用者還可以透過互動 SAIF 風險地圖瞭解在 AI 開發過程中如何引入與緩解不同的安全風險。

本站內容由互聯網用戶自發貢獻,該文觀點僅代表作者本人。本站僅提供信息存儲空間服務,不擁有所有權,不承擔相關法律責任。如發現本站有涉嫌抄襲侵權/違法違規的內容,請發送郵件至舉報,壹經查實,本站將立刻刪除。