我為什麼離開OpenAI?六年元老發離職長文:AGI將至,我們遠沒準備好

2024-11-10 01:34:21 2

OpenAI的「員工叛逃」還沒有結束。

近日,OpenAI又有一位6年元老、研究主管Miles Brundage發表長文官宣離職,並詳細解釋了自己為何「出走」。

作為一家年輕的AI獨角獸,成立於2015年的OpenAI如今剛剛9歲,因此在公司待了6年之久的Brundage足以被稱為「元老」,見證了OpenAI如何一路起伏、篳路藍縷地走到今天。

在博文中,Brundage也在開頭強調:為OpenAI的高管和董事會提供建議,為AGI的到來做準備,這實際上是他夢想中的工作;甚至就在2015年OpenAI剛成立時,Brundage興奮得一夜不睡,寫下一篇博文強調這個組織的重要性。

原文地址:https://www.milesbrundage.com/blog-posts/archives/12-2015

因此,離開OpenAI對他來說並不是一個容易的決定。但是為了有更多時間研究自己認為重要的課題,更獨立、自由地發表觀點和作品,Brundage決定轉而加入(甚至自己創辦)非營利組織,將重點放在AI政策研究和倡導上。

Miles Brundage本科畢業於喬治華盛頓大學,本科期間擔任過美國能源部的特別助理,之後前往亞利桑那州立大學攻讀博士,研究方向為科技的人類和社會維度,博士後期間曾在牛津大學擔任AI政策研究員。

2018年,Miles Brundage加入了剛剛成立3年的OpenAI擔任政策方面的研究科學家,之後又在2021年升任研究主管,目前是AGI準備工作的高階顧問。

為何離開OpenAI

總體來看,Brundage的離職是希望從行業外部而非內部影響AI的發展,這與今年Geoffrey Hinton離開谷歌的原因如出一轍,具體有如下幾個考慮因素:

機會成本

本職工作已經佔去了幾乎全部的時間,因此Brandage感覺很難從事自己認為重要的研究課題。甚至在某些情況下,身處行業之外時,從事這些研究能更有影響力和說服力。

而且,OpenAI目前已經如此引人注目,成果釋出前就需要從許多不同的角度進行審查,以至於無法發表某些主題的文章。

但值得注意的是,Brundage並不是完全反對OpenAI在出版物審查方面的立場,他認為行業中存在出版限制是合理的,他本人也幫助編寫了OpenAI政策的幾個迭代版本,但公司目前施加的限制確實已經太多了。

減少偏見

如果選擇成為某個組織的一部分,並且每天都和那裡的同事們密切合作,你就很難對這個組織保持公正。

Brundage表示,他在分析中盡力追求公正,但仍然會有偏見的存在。而且在OpenAI工作這件事本身,就會影響到外界如何看待自己的觀點和研究。考慮到財務利益上的衝突,人們有理由質疑來自行業的政策想法。

在有關政策的對話中,有更多獨立於行業的聲音至關重要,而Brundage計劃成為其中之一。

在OpenAI,能做的都做了

從入職至今,Brundage認為自己作為「AGI準備狀態高階顧問」的工作已經完成了大部分。

「AGI準備狀態」(AGI Readiness)主要分為兩種:一是OpenAI要準備好管理日益強大的AI能力,二是整個世界也要準備好有效管理AI能力,包括透過監管OpenAI和其他公司。

對於前者,Brundage已經向他的負責物件——OpenAI的高管和董事會——詳細介紹了他認為OpenAI需要做什麼,以及差距在哪裡;而對於後者,他認為自己在OpenAI外部能夠更加有效。

雖然失去了一些在OpenAI發揮影響力的機會,但Brandage希望在更大程度上影響整個生態系統。

AGI,我們都沒準備好

Brundage認為,對於即將到來的AGI,OpenAI或任何其他的前沿實驗室都還沒有準備好,這個世界也還沒有準備好。

原文地址:https://medium.com/@miles_24227/scoring-humanitys-progress-on-ai-governance-5a5131cb84c7

但需要明確的是,他不認為這種「沒準備好」的狀態與OpenAI領導層的宣告相沖突;同時他也暗示,雖然距離理想的標準存在相當的差距,但是我們仍可以在相關時間點步入正軌,為此Brundage將在餘下的職業生涯中致力於人工智慧政策。

科技公司和這個世界是否走上了AGI準備的正軌,是一個複雜的函式,取決於安全和保障方面的文化如何隨著時間的推移而發揮作用、監管如何影響組織的激勵措施、各種有關AI能力和安全方面困難的事實,以及各種其他因素。

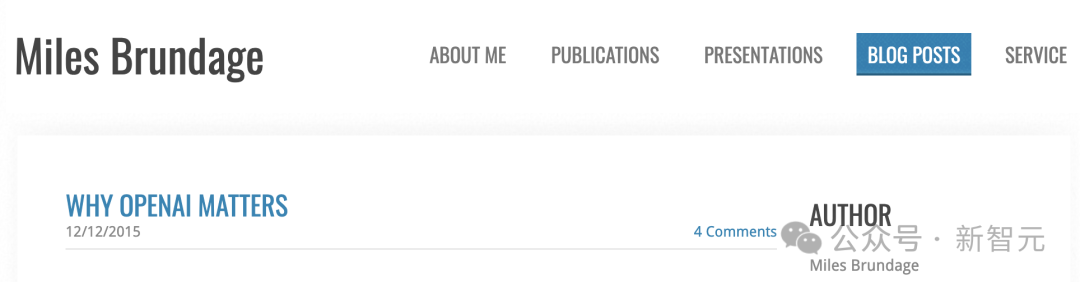

此處,Brundage特別表揚了OpenAI最近新增加董事會成員的決定,新吸納的成員包括前陸軍上將Paul M. Nakasone和CMU機器學習系主任Zico Kolter,這都是朝著正確方向邁出的一步。

順便一提,Brundage表示,「AGI」這個術語承載了太多意義,它現在更多地暗示著一種二元思維方式,而不是實際意義,因此有必要澄清一下,此處的「為AGI做好準備」,指「準備好安全、可靠且有益地開發、部署和管理能力日益強大的AI系統」。

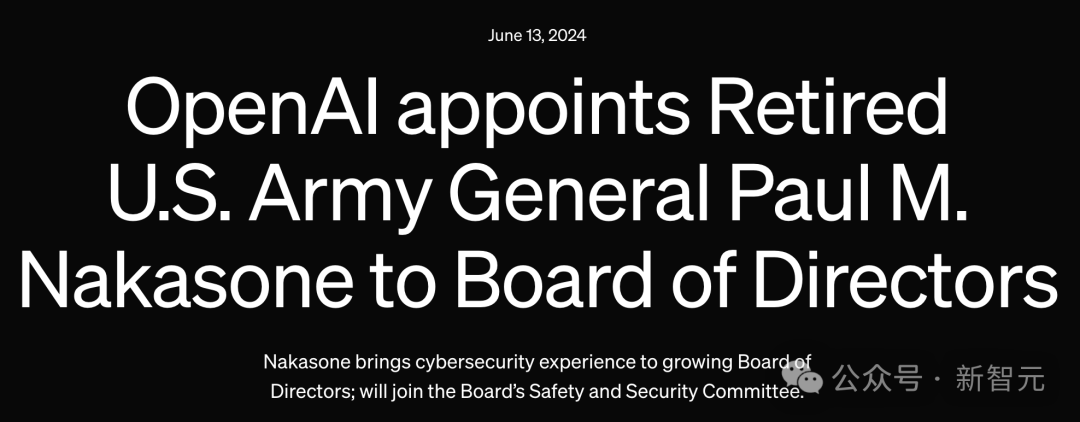

最近,他和團隊正在充實OpenAI提出的AGI五級框架,不久後或許會發表一篇正式的論文。這個框架曾被彭博社披露,引來了不少爭議。

雖然Brundage對AI政策抱持著謹慎和批判的態度,但對於AGI前景的預測,他的確稱得上是一個「技術樂觀主義者」,觀點與矽谷的風投大佬Khosla非常一致。

他認為,在未來短短的幾年內,人工智慧很可能能夠實現足夠的經濟增長。假設我們能制定出適當的政策來確保公平分配,人類就能實現高生活水平的提前退休。

但在此之前的短期時間中,AI很可能會搶走一些迫切需要工作的人的機會,尤其是那些可以遠端完成的、容易自動化的任務。

但事實是,人類最終應該擺脫為謀生而工作的義務,這也為構建AI和AGI提供了最強有力的論據之一。從長遠來看,有些人可能會繼續工作,但不會像現在這樣有如此迫切的激勵因素。

一個「後工作世界」(post-work world)的風險之一就是文明的停滯(比如電影「機器人總動員」所展現的),但我們目前還沒有在政治、文化或其他方面為此做好準備,因此需要更多的思考、辯論和政策討論。

2008年電影「機器人總動員」(WALL-E),由皮克斯工作室製作、迪士尼出品

很多人都描繪過「AI造福人類」的前景,這些描述似乎是出於好意而非陰謀論。但目前存在效率低下的問題,很大程度上是由於民間社會和政府的技術專業知識不足,以及缺乏良好的規範和理論基礎。

例如,對於出現的問題,我們是否應該期望市場機制給出解決方法?什麼時候應該構建定製化、應用範圍狹窄的AI解決方案,什麼時候應該提高通用AI系統的能力來解決?在各種情況中,正確的方法是繼續補足現有的技術,還是創造全新的技術,等等。

要不要在OpenAI工作

「要不要在OpenAI工作」,這個問題聽起來有點凡爾賽,可以類比下「斯坦福和MIT該選哪個」。

但如果螢幕前的你拿到了offer正在糾結該去OpenAI還是谷歌DeepMind,Miles Brundage的經驗或許能幫助你解決這個甜蜜的煩惱。

在OpenAI工作是大多數人希望能做到的最有影響力的事情之一,所以在大多數情況下,答案是肯定的。

考慮到每個人擁有的技能和機會不同,很難做出籠統的陳述,但有一點是確定的——OpenAI 的每一個角色,以及每個人對待工作的謹慎程度都很重要,對OpenAI組織文化的每一項貢獻也很重要。

在通往更強大AI的道路上,每一次產品的部署都會發揮重要作用,比如影響行業規範,以及人們認知和監管AI的方式。

在OpenAI工作,無論是AI的安全與保障,抑或是AI能力和產品方面的研究,發揮個人的能動作用來推動AI安全都是非常有影響力的。

下面這段話,似乎是Brundage的一段隔空喊話,寫給他仍在OpenAI工作的前同事們:

「任何在OpenAI工作的人都應該認真對待這樣一個事實:他們的行為和言論有助於組織文化,並且當這個組織開始掌管極其先進的能力時,可能會創造正面或負面的路徑依賴。文化對任何組織都很重要,但在前沿AI的背景下尤其重要,因為大部分決策不取決於監管法規,而是來自公司中的人。」

正如Brundage在前文所表示的,他認為某些政策研究最好在外部進行,AI的安全和保障工作有時也是如此。儘管OpenAI內部確實需要一些人來推動公司採取良好的政策立場,但存在獨立的安全研究也很有價值。

本站內容由互聯網用戶自發貢獻,該文觀點僅代表作者本人。本站僅提供信息存儲空間服務,不擁有所有權,不承擔相關法律責任。如發現本站有涉嫌抄襲侵權/違法違規的內容,請發送郵件至舉報,壹經查實,本站將立刻刪除。