AI能具備人類的責任感嗎?

2024-08-31 18:23:52 16

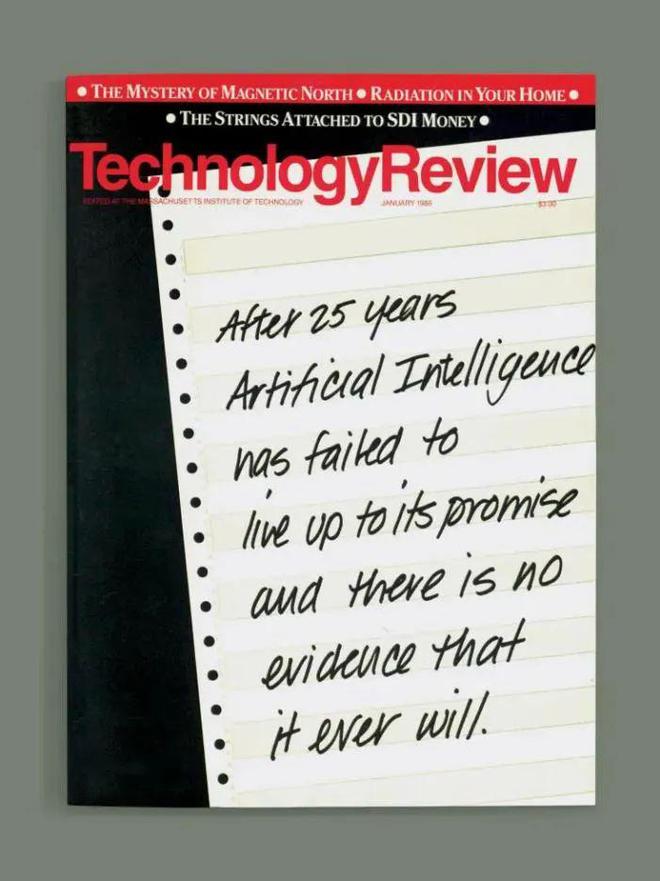

(來源:MIT TR)

“如果機器要與人進行智慧互動,它就必須具備對人類生活的理解。”

—— Hubert Dreyfus 和 Stuart Dreyfus

大膽的技術預測鋪就了謙遜之路,即使是像阿爾伯特·愛因斯坦這樣的偉人,也在那條卑微的高速公路上擁有一兩塊廣告牌。

一個典型的例子是,現代計算機體系架構先驅馮·諾伊曼在 1949 年寫道:“看來我們似乎已經達到了計算機技術所能實現的極限。”

社會心理學家 Frank Rosenblatt 在 1958 年提出的人腦神經網路模型是打破“計算極限”的眾多表現形式之一,其違背了馮·諾依曼的預測。

他將其基於 IBM 704 大型計算機開發的裝置稱為“感知器(Perceptron)”,並訓練它識別簡單的模式。這種感知器的出現促進了深度學習和現代人工智慧的發展。

Hubert Dreyfus 和 Stuart Dreyfus 兄弟是加州大學伯克利分校的教授,他們的專業截然不同,Hubert Dreyfus 是哲學專業,而 Stuart Dreyfus 是工程學專業。他們在 1986 年 1 月《麻省理工科技評論》的一篇報道中寫道,在一項類似大膽但有缺陷的預測中,“科學家幾乎不可能開發能夠做出智慧決策的機器。”

這篇文章摘自 Hubert Dreyfus 和 Stuart Dreyfus 當時即將出版的書籍《機器心智》(麥克米倫出版社,1986 年 2 月)。書中描述了他們對於人類“專有技術”或技能獲取劃分的五階段模型。Hubert Dreyfus(於 2017 年去世)長期以來一直是人工智慧的批評者,他早在 20 世紀 60 年代就發表和撰寫了持懷疑態度的論文和書籍。

Stuart Dreyfus 目前仍是加州大學伯克利分校的教授,他對人工智慧所取得的進步印象深刻。“我想我對強化學習並不感到驚訝。”他說,“我仍然對某些人工智慧應用持懷疑態度,並有些擔憂,尤其是大型語言模型(LLM),比如 ChatGPT。”

“機器沒有身體(或者說是實體),而脫離實體會帶來限制併產生風險。”他指出,“在我看來,在任何涉及生死可能性的領域,人工智慧都是危險的,因為它不知道死亡意味著什麼。”

根據德雷福斯技能習得模型,隨著人類知識和技術的進步會經歷五個發展階段的發展,並逐漸發生內在轉變。五個發展階段分別是:新手、高階新手、勝任者、精通者和專家。

“新手和勝任者之間的一個關鍵區別在於他們的參與程度。”研究人員解釋說,“新手和初學者對自己所做的事情幾乎沒有責任,因為他們只是在應用所學到的規則。”如果他們失敗了,他們就會把失敗歸咎於規則。

然而,專家感到對自己的決定負有責任,因為隨著他們的專業知識深深植根於他們的大腦、神經系統和肌肉(一種身體技能)中,他們學會操縱規則來實現他們的目標。

智慧決策和責任之間密不可分的關係是一個文明社會正常運轉的重要組成部分。一些人表示,當今的專家系統缺少這種關係,另外還缺乏關心、分享擔憂、做出承諾、擁有和解讀情感的能力,所有這些人類智慧的方面都來自於身體的存在以及在現實世界的社會活動。

隨著人工智慧繼續滲透到我們生活的方方面面,我們能否教會下一代專家系統對自己的決策負責?責任、關心、承諾或情感是否可以從統計推論中得出,或者從用於訓練人工智慧的有問題的資料中得出?也許吧。但即便如此,機器智慧也不會等同於人類智慧,它仍然會有所不同,正如 Dreyfus 兄弟在四十年前所預測的那樣。

本文作者 Bill Gourgey 是一位居住在華盛頓特區的科普作家。

https://www.technologyreview.com/2024/08/28/1096801/responsible-machines-computers-human-intelligent-decisions/

本站內容由互聯網用戶自發貢獻,該文觀點僅代表作者本人。本站僅提供信息存儲空間服務,不擁有所有權,不承擔相關法律責任。如發現本站有涉嫌抄襲侵權/違法違規的內容,請發送郵件至舉報,壹經查實,本站將立刻刪除。